まずは「利用ルール」を決めよう

これからAI活用を始めたい企業が陥りがちなのが、「最初から完璧なルールを作ろうとして挫折する」パターンです。佐久間氏は「政府が出している『AI事業者ガイドライン』は200ページを超える詳細なものですが、これを最初から最後まですべて読み込む必要はありません。自社にいま必要な情報を見極めて参照していくことが重要です」といいます。

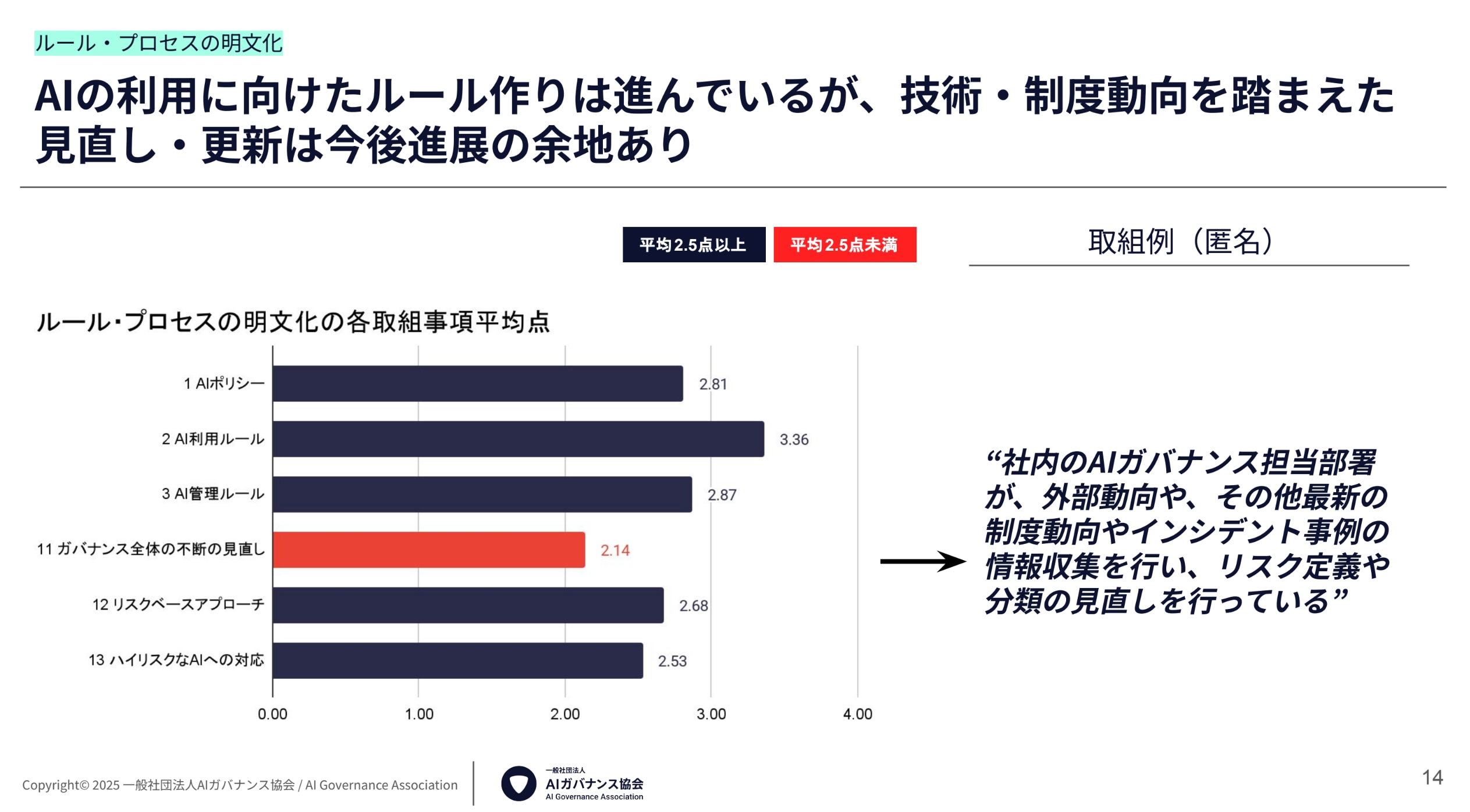

佐久間「私たちが実施した調査でも、多くの企業がまずは『利用ルール』の策定から始めています。これは『個人情報・機密情報は入力しない』『AIの回答を鵜呑みにせず、ファクトチェックで事実を裏取りする』といった、社員がAIツール(ChatGPTなど)を業務で使う際の、もっともベースとなる決まり事です」

特に高度な個人情報や機密情報を扱う領域を除き、一社員が業務で利用する際の留意点やルールに関しては、実は企業ごとの差異が比較的出にくい部分だと言えます。

そのため、ゼロから自作するのではなく、JDLA(一般社団法人日本ディープラーニング協会)が公開している生成AIの利用ガイドラインのひな形など、すでに世の中に出ているテンプレートをうまく活用するのが近道だと佐久間氏は助言します。

佐久間「生成AIの利用ルールづくりに関する資料は、他にもさまざまな企業や団体によって公開されています。いまの自社や部署に必要なものを組み合わせ、同僚たちと意見交換しながら、使いやすいルールをつくっていくといいと思います」

「禁止」よりも「安全な環境」を

社員が個人のアカウントで勝手にAIを使ってしまう「シャドーAI」も問題になっています。「生産性アップのために活用したい」という動機を、どれだけ許容すべきか悩みどころです。

実際のところ、個人レベルではどれだけポジティブな動機でも、業務にかかわる情報を私的に扱うのはトラブルの可能性も。佐久間氏は、頭ごなしの禁止よりも安心して使える環境整備が重要だと指摘します。

佐久間「社員が個人で契約したツールや私的なPCで業務上必要なデータを扱うのは、会社が適切なツールを提供していないから、という側面も大きい。できれば会社として法人向けプランなどを契約し、『こういう設定になっているので、ここまでの情報を入れてOK。情報は学習されないので安心して使ってください』と周知するのがベストです」

少人数のチームでの導入であれば、比較的コストも少なく済みます。環境を整備せずに「使うな」と言うだけでは、隠れて使われるリスクを高めるだけになりかねません。

法律の変化、抑えたいポイントは?

ルール策定において避けて通れないのが法律の問題です。2025年5月には、日本で初めてAIに特化した法律「AI推進法」(人工知能関連技術の研究開発及び活用の推進に関する法律)が施行されたばかりです。

弁護士でもある同協会事務局のリサーチフェローの宮原瑞穂氏は、特に今後の動向を注目してほしいのは「知的財産権」と「個人情報」の分野だと言います。

宮原「日本は“世界一AI開発がしやすい国”を目指して、著作権法などでAI学習に寛容な立場を取ってきました。しかし、AI開発者や事業者に対し、学習データの要約を開示するなどの透明性を求める流れが出てきています」

個人情報の扱いについても変化の兆しがあります。

宮原「現在、検討されている個人情報保護法の改正案では、AI開発(学習)のみに使われることが担保されていれば、本人の同意なしでも第三者提供が可能になるような規制緩和が議論されています」

いずれも検討段階ではありますが、AI関連の議論はハードロー(法的な拘束力を持つ法律や条例)、ソフトロー(強制力を持たない関係者間の取り決め)とも、いずれも動きが速いのが特徴です。

宮原「各国がAI開発と法的な規制の在り方のバランスで試行錯誤しており、次々と新たな方向が打ち出されているのが現状です。日本でも、政策次第で企業の活動に影響が出る可能性は十分あるため、注視が必要です」

外注先ともルールを共有

自社でルールを作っても、見落としがちなのが、委託先など外部パートナーのリスクです。例えば、委託先のライターやデザイナーがAIを使っており、目の届かないところで自社の機密情報がAIに学習されてしまったり、納品物が他者の著作権を侵害していたりするリスクはありえます。

宮原「契約書や発注時の確認事項に盛り込むのが有効です。例えば、『当社のAIポリシーや指針を遵守してください』と約束させたり、AIを利用している場合は申告させたりする。また、納品物に対しては、発注者側でもGoogle画像検索にかけるなどして、既存の著作物に酷似していないかチェックするプロセスは必須になっていくでしょう」

AIで生成されたものである可能性を前提に動くことが、最低限のリスク管理になっていくはず。発注者側もAIに親しんでおくことでチェックする際も理解や判断がしやすくなり、リスクヘッジになるという考え方もできます。

「AIが重要なのはわかるけれど、なんとなく怖い」「もしトラブルが起きたら責任が取れない」——最終回となる第3回では、そうした漠然とした心理的な壁をどう乗り越えられるかを考えていきます。

この記事はNTTドコモビジネスとNewsPicksが共同で運営するメディアサービスNewsPicks +dより転載しております。

取材・文・編集:山崎春奈

デザイン:山口言悟(Gengo Design Studio)

EN

EN